"AI 악용 가짜뉴스, CCTV처럼 감지할 수 있는 기술 적용해야"

- 사전 훈련된 AI로 악의적 가짜뉴스, 가짜 댓글 '난무'

- 기존 가짜뉴스 탐지 한계...대부분 영어 설계, 한국어 데이터셋 없어

- 댓글 뒤 출처 LLM 밝혀내 세밀한 분석 가능해야

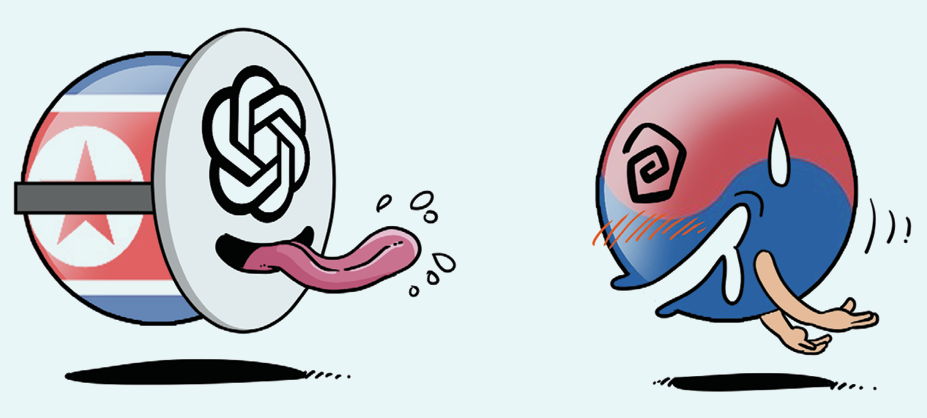

AI기술 발달로 가짜뉴스와 가짜 댓글이 판을 치고 있다. 가짜뉴스와 가짜 댓글은 사전에 훈련된 대형 언어 모델(LLM)을 통해 기만적인 콘텐츠를 만들거나, 악의적 목적으로 사실을 의도적으로 조작해 가짜 정보를 생성한다.

또 공격 대상의 정치적 정당성을 훼손하는 허위 조작 정보를 유포해 여론을 조작하고, 사회 혼란 야기시킨다. 가짜 댓글 역시 짧고 비공식적이며 쉽게 조작된다. 특히 기존 봇 텍스트보다 탐지하기 어렵단 게 전문가 분석이다.

상황이 이렇다 보니 가짜뉴스와 허위조작 정보를 탐지하고 펙트를 체크하는 기술이 갈수록 중요해지고 있다.

하지만 기존 탐지 방법엔 한계가 있다. LLM 탐지 대부분이 긴 형식의 영어 텍스트를 위해 설계됐다. 어휘와 구문 복잡성에 대한 탐지 기술 부족은 통계적 탐지를 제한한다. 뿐만 아니라 훈련을 위한 현실적인 한국어 LLM 생성 댓글 데이터셋이 없다.

고우영 국가보안기술연구소 선임연구원은 '2025 사이버안보 최신 이슈 세미나'에서 LLM 탐지 어려움 해결을 위해 "여러 LLM과 고급 기술을 사용해 현실적인 댓글을 생성해 교육 데이터를 구축해야 한다"며 "LLM과 인간이 작성한 텍스트 간의 문체와 언어적 차이를 식별해 언어 패턴을 추출해야 한다"고 말했다.

그러면서 LLM 생성 유무를 감지하고 속성을 부여하는 프레임워크가 필요하다고 제안했다. 가짜뉴스 탐지 통계는 단어 의미 특성, 문법 특성 분석, 범주 특성 분석 등 다양한 정보로 분석돼야 하고, 펙트 체킹은 주체의 특징, 전문가 신뢰할 수 있는 외부정보(reference)와 비교로 펙트를 체크해야 한단 설명이다.

고우영 선임 연구원은 "각 댓글 뒤에 있는 출처 LLM을 밝혀내어 세밀한 분석이 가능해야 한다"며 "약물 검사나 CCTV와 같은 정확한 감지만으로도 오용을 억제할 수 있는 것처럼 댓글이 노출되고 추적될 수 있단 사실 인지로 사전 예방을 해야 한다"고 강조했다.

Related Materials