크롬용 클로드 플러그인, 사람 중심 보안의 근간을 흔들다

- 인공지능 회사 앤트로픽에서 만든 브라우저 플러그인

- 인간을 대체하는 강력한 기능 때문에 현대 보안 근간 흔들려

- 인간이기에 가능한 책임 귀속과 수정 가능성, 인공지능에는 없어

Juniors, 안녕!

테크를 가장 날카롭고 가치 있게 읽어주는 더테크엣지 아빠들이야.

지난 달 인공지능 기업 앤트로픽(Anthropic)은 크롬 브라우저용 플러그인을 하나 개발해 발표했었어. 크롬 사용자가 보다 편리하게 인공지능의 강력함을 활용할 수 있게 할 것이라는 목표로 만들어진 이 플러그인은 ‘클로드 크롬 플러그인(Claude Chrome extension)’이야. 정식 출시된 건 아니고 아직 베타 버전이야. 실험 단계에 있다고 볼 수 있지. 그런데 보안 기업 제니티(Zenity)가 이 플러그인에 심각한 문제가 있다고 지적했어.

어떤 문제가 발견됐나?

이번 클로드 플러그인에서 발견된 문제는 단순하지 않아. 한 개의 버그로 간편하게 지정하거나 설명할 수 없어. 제니티의 연구원들은 “플러그인 개발 당시 적용했던 보안 모델 자체가 문제”라고 하면서, “보다 정확히 표현하자면, ‘브라우저는 인간이 사용한다’는 가정이 붕괴된 것이라고도 말할 수 있다”고 표현하기도 하는데, 솔직히 이 설명도 어렵지? 쉽게 풀어보자.

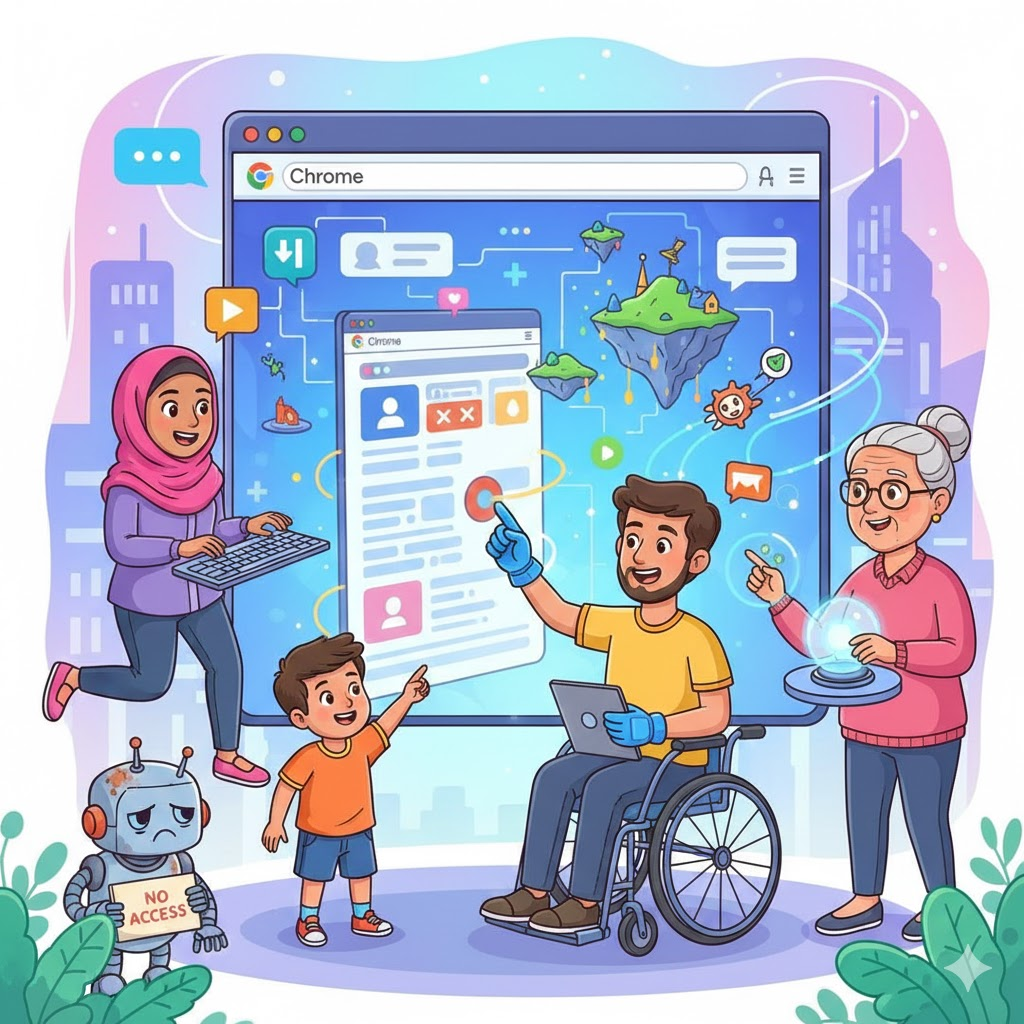

너희들도 인터넷 자주 이용하지? 그럴 때 보통 크롬이나 에지나 파이어폭스 같은 ‘브라우저’를 주로 활용할 거야. 브라우저를 켠 다음, 원하는 사이트에 찾아 들어가고, 그 사이트에서 화면에 나타나는 버튼이나 링크를 클릭하고, 이름이나 비밀번호를 입력하고, 문의를 남기고, 심지어 결제도 할 수 있지. ‘사람’인 너희들이 여러 가지 행동을 할 수 있도록 만들어진 게 바로 이 ‘브라우저’라는 프로그램이야. (‘확장 프로그램’이라고도 하는 플러그인은 그런 브라우저에 덧대는 추가 기능들을 말해. 위의 클로드 플러그인이 바로 그런 것이지.)

결국 우리가 ‘인터넷을 이용한다’고 하는 건 거의 대부분 ‘브라우저를 사용한다’와 거의 같아. 너희들이 좋아하는 인터넷 게임을 하려면 일단 브라우저를 통해 그 게임 개발사 페이지에 들어가 게임을 다운로드 받아야 하지. 멀리 있는 누군가에게 돈을 보내려고 해도 브라우저를 통해 은행 페이지에 입장한 뒤에 할 수 있고, 옷을 사는 것도 마찬가지야. 멀리 있는 사람들끼리 브라우저라는 걸 통해 많은 걸 주고 받아. 브라우저를 사이에 두었을 때 우리는 아무리 멀리 있는 사람들이라도 마주본 것처럼 할 수 있는 거야.

그런데 인터넷 공간에 너희처럼 좋은 사람들만 있는 건 아니야. 우리가 브라우저를 가지고 은행 업무를 본다거나, 게임을 다운로드 받는다거나, 쇼핑을 할 때, 중간에 끼어들어 뭔가를 가로채려는 사람들이 많아. 실제 우리가 살아가는 공간에도 은행 강도가 소매치기가 있는 것처럼, 이들은 인터넷 공간에서 강도짓을 하고 자기 것이 아닌 걸 훔쳐내지. 보통 해커라고 부르는 부류들이야. 그래서 브라우저를 사이에 두고 멀리에 있는 사람과 사람이 대화를 하거나 거래를 할 때, 우리는 여러 가지 안전 장치들을 마련해 스스로를 보호하고 있어. 브라우저 자체에도 이런 장치들이 있고, 브라우저를 통해 우리가 찾아들어가는 웹사이트들에도 있어. 우리 사용자들은 특별히 느끼지 못하지만, 상당히 많은 것들의 보호를 받고 있어.

‘인간이 있다’는 가정

인터넷 세상에는 여기에 죄다 쓸 수 없을 만큼 많은 안전 장치들이 존재해. 서로 기능도 다르고, 성능도 달라. 그런데 한 가지 공통점이 있어. 바로 ‘브라우저를 사용하고 있는 건 인간이다’라는 가정 하에 만들어졌다는 거야. 브라우저 내에서 마우스 클릭을 한 것도 당연히 인간이라고 여기고, 로그인 창에 이름과 비밀번호를 입력한 것도 인간일 수밖에 없다고 생각한다는 것이지. 그래서 거기에 맞게 안전 장치들을 개발해 왔어.

그런데 거기에 클로드 플러그인이라는, 인공지능 도구가 하나 새롭게 들어온 거야. 이 플러그인은 브라우저를 통해 클릭도 하고, 타이핑도 하고, 페이지를 왔다 갔다 하면서 탐색도 할 수 있어. 마치 사람처럼 말이야. 사람이 아닌데 사람과 똑같이 행동할 수 있고, 그렇기 때문에 ‘브라우저를 작동하는 건 사람이다’라는 가정으로 만들어진 안전 장치들이 제대로 기능을 발휘하기 힘들어진 거야.

왜 그런 걸까? 어차피 인간이 브라우저를 움직인다 해도 그저 클릭이나 하고 타이핑만 할 뿐인 건데, 인공지능이 그걸 대신 한다고 해서 달라질 게 뭘까? 이런 질문이 떠올랐다면 아주 날카로운 거야. 그 질문에 대한 답을 이어가도록 하자.

인간 중심 보안

‘사람이 브라우저를 움직이고 있다’는 가정이라는 건 단순히 ‘클릭을 한 게 사람이다’를 의미하는 게 아니야. 그 클릭을 하기 전까지 ‘사람이 보고 이해하고 고민하고 결정했다’까지도 포함해. 즉 브라우저 내 안전 장치들 입장에서는 ‘클릭이 있었다’만 보는 게 아니라, ‘인간이 스스로 생각하고 이해하고 판단하여 행위를 했고, 그 행위의 결과가 클릭이므로, 그 클릭을 처리해 주는 건 안전하다’고까지 결론을 내리는 거야. ‘인간이 브라우저 뒤에 있다’는 건 ‘인간이 자신의 의도 대로 움직인다’는 것이고, ‘그러므로 그 판단은 안전하다’는 개념으로 이어지지.

그런데 이걸 인공지능이 대신한다면? ‘클릭할 것을 인간이 직접 보고 이해하고(혹은 조사하고) 판단까지 하고서 클릭한다’는 순서대로 사건이 이어지지 않지. ‘인공지능이 브라우저 내 클릭할 것들 중 사용자가 자주 클릭하는 걸 클릭한다’로 뒤바뀌게 되어 있어. 그러면 사용자의 의도나 결정이 반영되지 않은 클릭이 발생하는 것이고, 그러므로 안전을 보장할 수 없게 돼. 하지만 현대의 브라우저 안전 장치들은 인공지능의 클릭이라 하더라도 인간의 의도가 반영된 클릭이라고 해석할 수밖에 없고, 그래서 안전치 않은 클릭들도 죄다 처리할 수밖에 없게 되며, 그래서 결국 위험한 결과를 낼 가능성이 높아져.

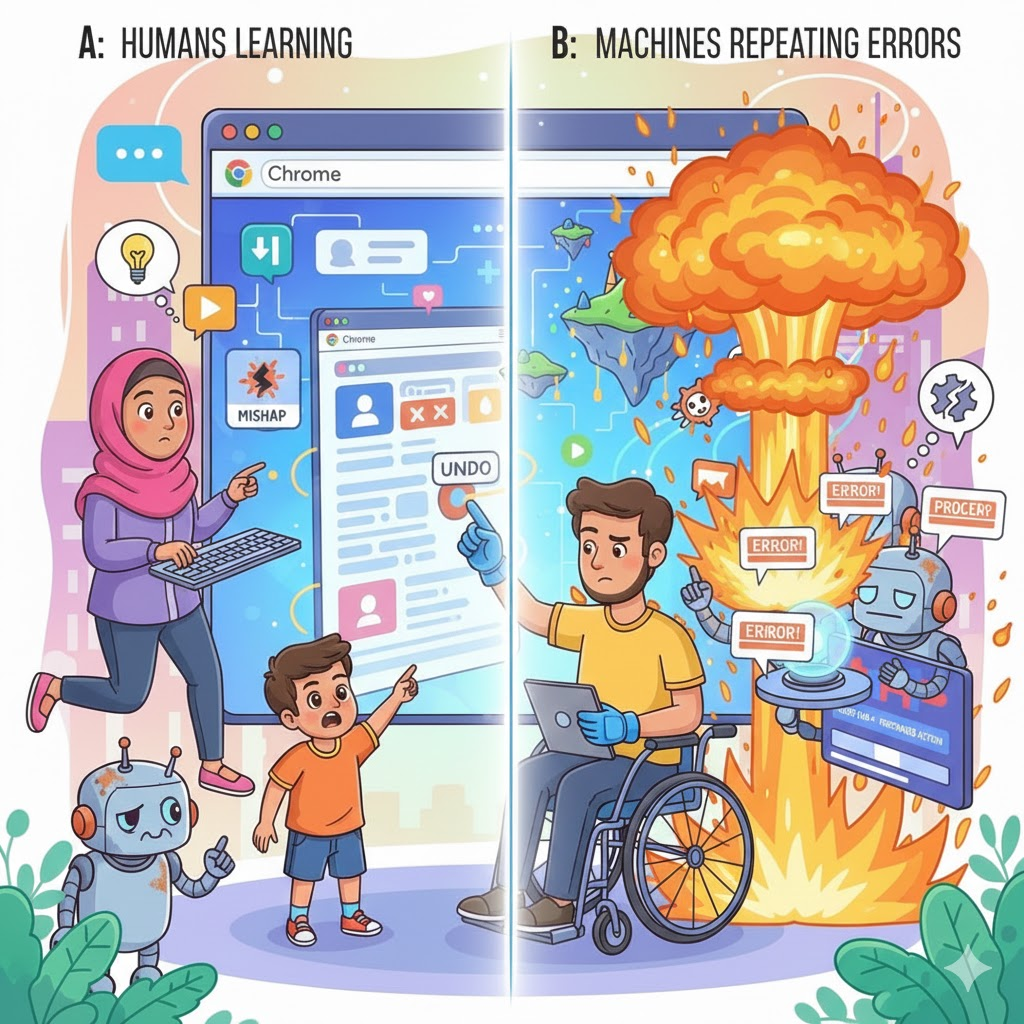

여기서 한 가지 더 궁금한 게 생길 수 있어. 인간의 판단이 항상 올바른 게 아니라는 거 말야. 인간이 의도를 가지고 클릭한다고 해서 모두 좋은 결과를 내는 건 아니지. 오히려 인공지능이 생각없이 클릭한 것보다 더 심각한 결과가 나오는 것도 가능해. ‘인간의 의도’가 반드시 안전한 게 아니라면, 인공지능의 브라우저 사용도 반드시 위험한 건 아니지 않을까?

타당한 지적이야. 여기서 생각해야 할 게 한 가지 더 있어. ‘인간이 브라우저 뒤에 있다’ 그러므로 ‘의도를 가지고 클릭과 타이핑을 수행한다’는 건 ‘인간의 의도와 판단은 100% 올바르다’를 의미하지 않아. 오히려 ‘인간이기에 실수와 오판이 충분히 있을 수 있다’까지도 포함해. 잘못된 클릭으로 큰 일이 벌어졌을 때, 그 클릭의 주체인 인간을 찾아 책임을 물을 수 있다는 뜻이야. 또, 그 실수의 주체가 인간이므로, 실수를 깨닫고 반성해 다음 클릭을 좀 더 조심히 할 수 있다는 기대감도 담고 있어. 그런 실수가 어떤 맥락에서 왜 발생할 수밖에 없었나를 연구함으로써 추후 사고를 예방할 수도 있지.

그러므로 ‘인간이 브라우저 뒤에 있다’는 건 ‘실수나 잘못을 추적하고 책임지게 하고 고칠 수 있다’는 의미까지 담고 있다는 것이 중요해. 이건 ‘사고는 일어날 수 있으나, 연쇄적으로 폭발하게 하지는 않는다’라는 의미이기도 해. 이게 인간을 중심으로 한 보안의 중요한 철학이기도 하지. 인공지능은 이걸 위배한다는 게 제니티의 지적이야.

인공지능의 위배

그러면 인공지능은 왜 ‘실수나 잘못을 추적해 책임지게 하고 고칠 수 있다’는 개념과 어울리지 않는 것일까? 제일 먼저 인공지능은 실수나 잘못을 인지하지 못해. 미래의 발전된 인공지능이라면 아닐 수도 있지만 적어도 현대 우리가 가지고 있는 것들은 그렇지 않아. 그러므로 브라우저에서의 잘못된 클릭에 대해 스스로 수정할 수도 없어. 클로드 플러그인도 마찬가지야.

개발사인 앤트로픽에 책임을 물으면 되지 않을까? 그럴 수 있지. 앤트로픽이 사고 사례들을 모아서 클로드 플러그인을 업데이트 함으로써 사고 확률을 줄이는 건 얼마든지 있을 수 있는 일이야. 심지어 클로드 때문에 큰 사고가 발생했을 때 법원이 앤트로픽에 벌금을 내라거나 보상하라고 판결을 내릴 수도 있지. 그런데 이건 ‘안전’과는 별개의 이야기야. 왜냐하면 안전은 지금 당장 실시간으로 보상되어야 하는 것이니까. 법원의 판결? 그건 사건이 일어나고서도 수년이 지나서야 나올까 말까한 일이야. 기술 수정? 이것도 최소 몇 개월은 걸릴 사안이고, 올바르게 수정된다는 보장도 없지.

이게 다 무슨 뜻일까? 클로드 플러그인을 설치해서 크롬 브라우저를 사용할 경우, 아무런 생각이 전제되지 않은 무차별적 클릭과 타이핑이 끊임없이 일어날 수 있다는 것이고(즉 사고 확률이 폭발적으로 높아진다), 사고 후 조치를 취할 마땅한 방안도 없다(책임을 물을 수도 급하게 수정을 할 수도 누군가를 교육할 수도 없다)는 의미야. ‘사람이 뒤에 있다’는 전제로 한 현대의 인터넷 보안이 아예 근간부터 흔들린다는 것이지. 우리는 아직 ‘사람이 아닌데 사람인 척 하는 무언가의 행위’를 안전하게 보호할 방법을 가지고 있지 않다는 게 제니티의 지적인 거야.

앤트로픽의 반박

앤트로픽이 이 지적에 반박했어. 사용자가 클로드 플러그인의 인공지능이 행동을 취하기 전에 사용자에게 허락을 구하는 안전 스위치를 탑재했다는 내용이야. 이 스위치가 있기 때문에 인공지능이 잘못된 행위를 폭발적으로 할 수도 없을 뿐더러, 사전 차단이 가능하다는 것이지. 하지만 제니티는 실험을 통해 “클로드가 가지 말라는 사이트에 여러 번 접속하는 사례가 있었다”고 밝혔어. 즉 안전 스위치가 있긴 하지만 인공지능의 모든 행동을 다 제어하지는 못한다는 의미가 돼. 아직 100% 안전한 스위치는 아닌 모양이야.

게다가 여기에는 또 다른 함정이 있었다고 해. 인공지능이 뭘 할 때마다 사용자에게 허락을 구하다 보니 사용자 입장에서는 ‘확인’ 버튼을 너무 많이 누르게 되는 거야. 그러다 보니 나중에는 허락을 구하는 내용을 확인하지도 않은 채 아무 생각 없이 확인을 누를 수밖에 없다고 해. 그 틈에 인공지능의 위험한 행위를 승인할 수도 있게 된다는 것이지. 사용자가 일일이 확인해주는 인공지능은, 사실 인공지능의 강점을 다 살리지 못하는 반쪽짜리이기도 하고 말이야. 좀 더 본질적인 수정이 필요해. 제니티가 ‘현대 보안 설계의 근본이 흔들렸다’고 표현한 건 다 이유가 있었던 것이지.

안타깝게도 이 글에서 이런 저런 걸 수정하면 문제가 해결된다고 말하기에는, 이 클로드 플러그인이 불러올 수 있는 폭풍이 지나치게 거세. 글 몇 줄로 안전 대책을 제시하기 힘들 정도의 큰 문제라는 거야. 지금은 다소 궁금하더라도 클로드 플러그인을 설치하지 말고, 일단 추이를 지켜보는 게 가장 안전해. 어차피 우리는 챗GPT나 제미나이, 퍼플렉시티 등 플러그인 없이도 사용할 수 있는 인공지능 서비스를 많이 알고 있잖아. 그런 것들을 사용하면서 플러그인에 대한 궁금증을 조금 완화시키는 게 좋아 보여. 어차피 지금 클로드 플러그인은 베타 버전이야. 완제품이 나오고 평가를 받을 때까지 관심을 가지고 지켜보자. 🆃🆃🅔

by 문가용 기자(anotherphase@thetechedge.ai)

Related Materials

- Claude Desktop Extensions Vulnerable to Web‑Based Prompt Injection - Infosecurity Magazine, 2025년

- Claude Desktop Hit by Critical RCE Flaws Allowing Full System Takeover - GBHackers, 2025년

- The Critical RCEs in Claude Desktop That Turn Questions Into Exploits (“PromptJacking”) - Koi Security, 2025년

- Using Claude in Chrome Safely - Anthropic 지원 문서, 2024년

![[TE머묾] AI 시대에, 혐오 직업 보유자로 버티기](https://images.unsplash.com/photo-1660212074310-6d7ed176c746?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDMyfHxib3hpbmd8ZW58MHx8fHwxNzcyMDA0ODEwfDA&ixlib=rb-4.1.0&q=80&w=600)

![[단독] 美 NIST, QKD 상용화에 한 발 ‘전진’](https://images.unsplash.com/photo-1733424114804-b7369094b139?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDIxfHxxdWFudHVtfGVufDB8fHx8MTc3MTgyOTY0MXww&ixlib=rb-4.1.0&q=80&w=600)

![[TE머묾] 실패의 굴레에 갇힌 한국](https://images.unsplash.com/photo-1713861808117-8a9a94af4661?crop=entropy&cs=tinysrgb&fit=max&fm=jpg&ixid=M3wxMTc3M3wwfDF8c2VhcmNofDI2fHxzaW5nYXBvcmUlMjBjb21tdW5pY2F0aW9ufGVufDB8fHx8MTc3MTgyMTU1MXww&ixlib=rb-4.1.0&q=80&w=600)